近期,Google 研究團隊發表了一項名為「TurboQuant」的全新免訓練(training-free)壓縮演算法,預計於 2026 年的 ICLR 國際會議上正式亮相。隨著大型語言模型(LLM)的應用日益普及,使用者輸入的上下文長度不斷倍增,導致模型運算時的「鍵值快取(KV Cache)」佔用呈現爆炸性成長,成為當前 AI 發展最致命的記憶體瓶頸。過去,產業界多依賴傳統的向量量化技術來縮減快取體積,但這些方法必須額外儲存量化常數,當面對超長文本時,這些微小開銷會不斷累加,最終嚴重侵蝕掉原本的壓縮效益。TurboQuant 的誕生,正是為了徹底消除這些隱藏的記憶體負擔。

為了達成「零量化常數儲存消耗」的創舉,TurboQuant 採用了創新的兩階段處理流程。第一階段導入 PolarQuant 技術,將數據向量從傳統的笛卡兒座標系轉換為極座標,巧妙地將向量分離為代表大小的半徑與代表方向的夾角。由於極座標下的角度分布高度集中且可預測,系統得以直接省略極度耗費資源的每區塊正規化步驟。第二階段則透過 QJL(Quantized Johnson-Lindenstrauss)演算法加入 1 位元的錯誤修正層,將殘餘誤差投影至低維度空間,並縮減至單一符號位元。這不僅幾乎沒有增加任何運算成本,更能有效消除注意力分數計算時的系統性偏差,確保模型的高精準度。

| 處理階段與技術 | 運作核心原理 | 達成效益 |

|---|---|---|

| 第一階段:PolarQuant | 將向量由笛卡兒座標轉為極座標,分離半徑與夾角。 | 省略耗費資源的區塊正規化,實現高品質壓縮與零常數儲存。 |

| 第二階段:QJL 演算法 | 1 位元錯誤修正層,將殘餘誤差投影降維並轉為單一符號位元。 | 無額外運算成本,消除系統性偏差,維持模型準確度不流失。 |

在 NVIDIA H100 GPU 及多項業界標準的長文本基準測試(如 LongBench、Needle In A Haystack 等)中,採用 4 位元版本的 TurboQuant 展現了驚人的實力:它不僅將計算效能提升高達 8 倍,更將 KV 快取記憶體需求量降低了至少 6 倍,且完全無需預先訓練或微調。這項技術突破對一般大眾與未來的硬體市場具有深遠的影響。對於習慣在本地端運行離線 AI 模型的使用者而言,過去動輒需要 24GB 甚至更高 VRAM 才能處理的超長上下文或複雜生成任務,未來只需配備 8GB 或 12GB VRAM 的主流設備(例如配備 RTX 3070 的工作筆電,或是搭載 RTX 5070 級別的桌機)便能流暢執行。這大幅降低了離線 AI 的硬體門檻。從宏觀市場來看,當軟體演算法能極致壓縮記憶體需求時,AI 產業對超大容量 VRAM 與高頻寬 DRAM 的硬體依賴度將可能趨緩,進而有望打破高階記憶體價格居高不下的局面,讓一般消費者能以更合理的價格享受頂級的 AI 運算體驗。

《上一篇》成人牙位圖:看懂牙醫病歷上的神祕數字與 FDI 表示法

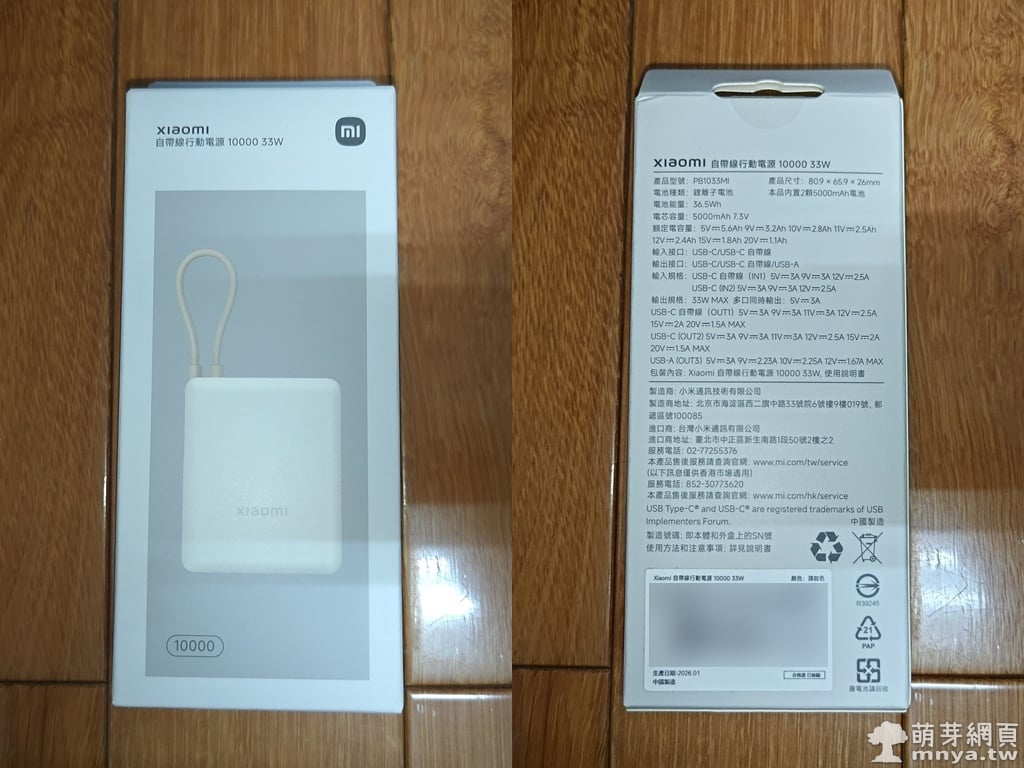

《上一篇》成人牙位圖:看懂牙醫病歷上的神祕數字與 FDI 表示法  《下一篇》【Xiaomi 小米】自帶線行動電源 10000 33W (淺咖色)

《下一篇》【Xiaomi 小米】自帶線行動電源 10000 33W (淺咖色)

留言區 / Comments

萌芽論壇