在 AI 繪畫的領域中,針對特定角色的「一致性」與「畫風表現」始終是創作者追求的核心目標。隨著由 CircleStone Labs 與 Comfy Org 合作開發的 Anima 模型問世,二次元動漫生成品質達到了新的高度。Anima 雖然僅有 2B 參數,但其基於 Cosmos 架構與 Qwen-3 大型語言模型(LLM)文字編碼器的特性,使其在線條質感與指令遵循度上具備極強優勢。為了能完美捕捉本站看板娘「萌芽娘」的視覺特徵,本次教學將採用 Anima Standalone Trainer 進行 LoRA 模型實戰訓練,讓角色在不同場景下都能維持穩定的外貌與服裝設定。

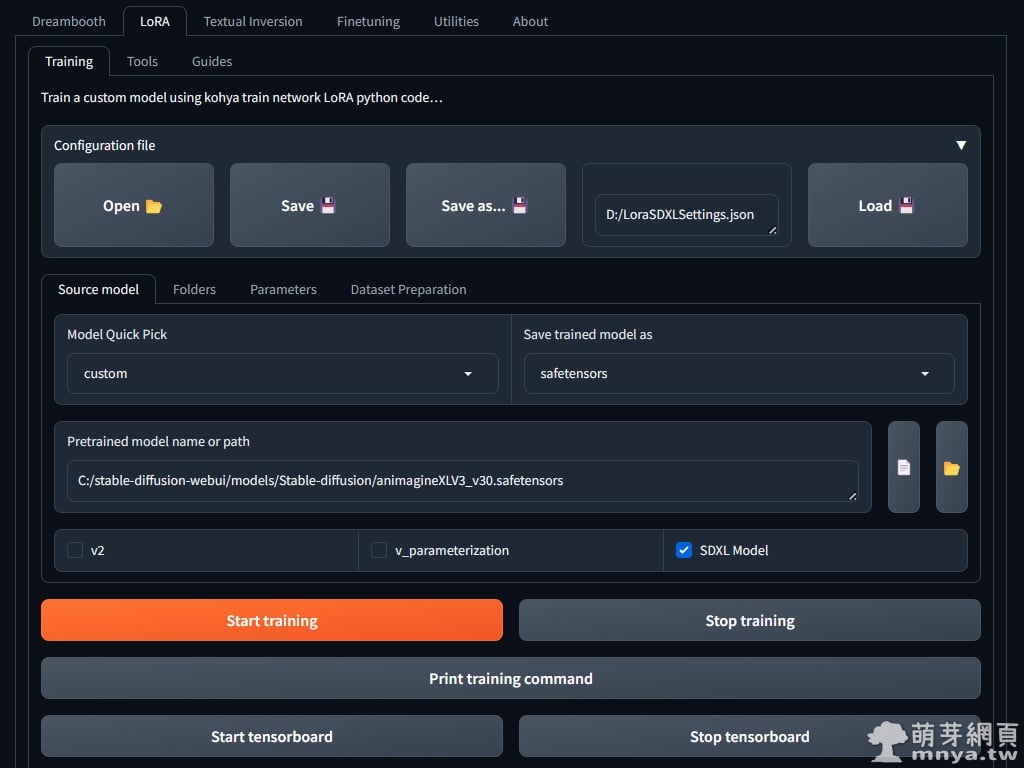

相較於通用的訓練工具,這款獨立訓練器針對 Anima 的特殊架構進行了底層優化,能精確加載 Qwen-3 文字編碼器而不產生權重衝突。在本次實戰中,我們針對消費級硬體特性,採取了 BFloat16 混合精度與 AdamW8bit 優化器,在確保訓練效率的同時也大幅降低顯存壓力。同時,透過將 network_train_unet_only 設為開啟,我們能夠在凍結文字編碼器的情況下,專注於提取角色的視覺特徵,避免模型損壞。接下來,我們將逐一解析訓練建置介面中的各項參數設定,帶領各位一次上手專屬動漫 LoRA 的訓練流程。

📝 閱讀本篇文章前,請先依照先前的安裝教學指南完成本工具的安裝、啟動與訓練前設定。

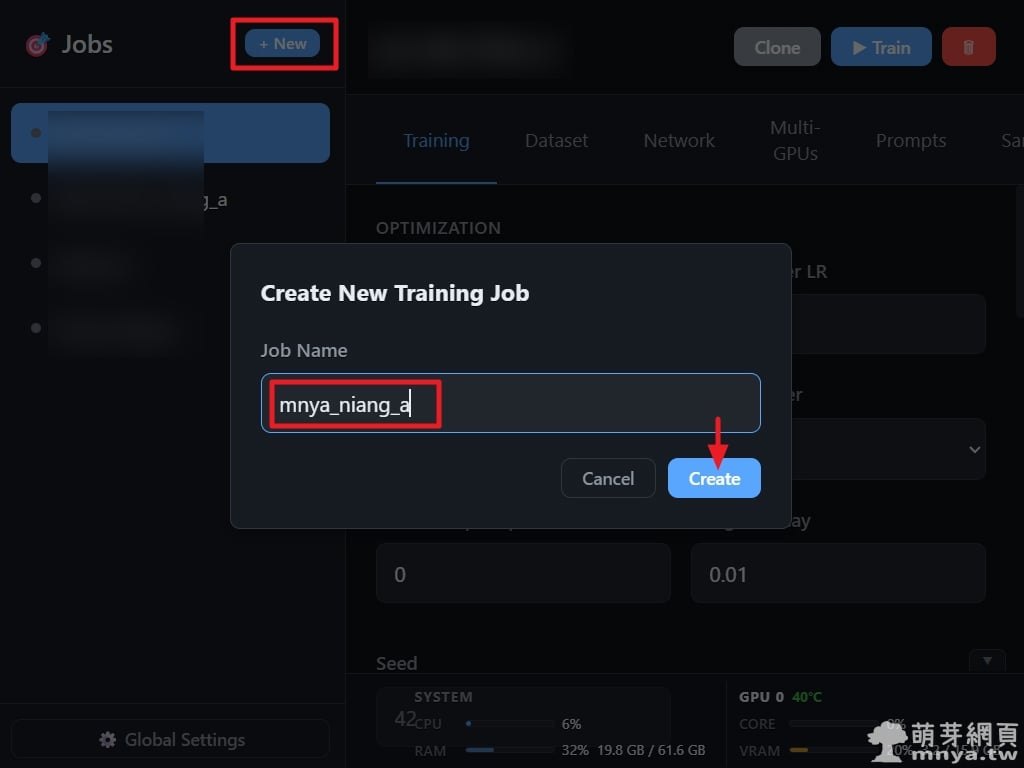

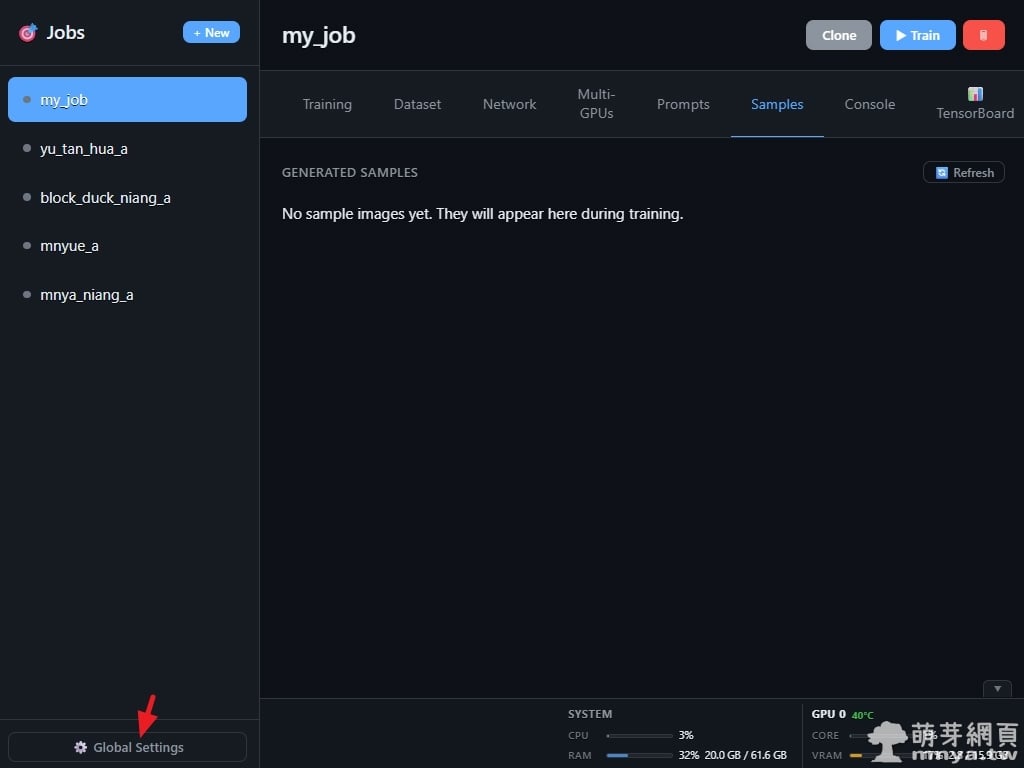

▲ 進入 Web UI 介面後,首先點擊左上角的「+ New」按鈕建立新的訓練任務。在彈出的視窗中輸入 Job Name,本次以「mnya_niang_a」為名。建立任務後,系統會生成獨立的專案目錄,方便未來針對不同參數組合進行快速複製與微調。

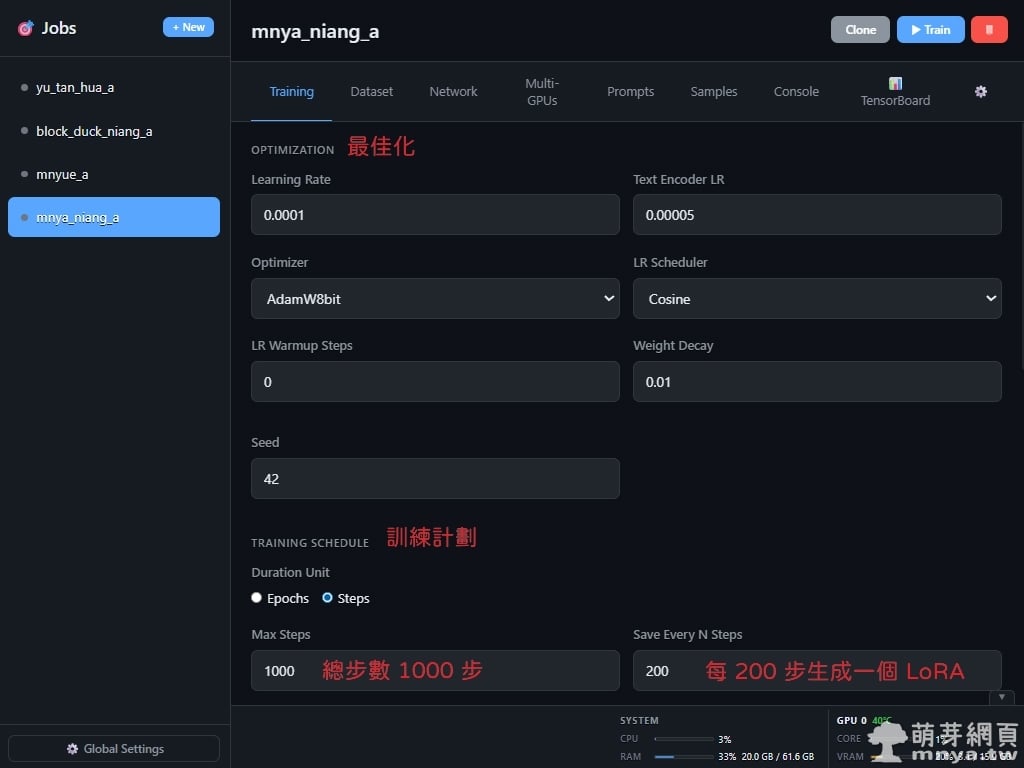

▲ 在「Training」分頁設定核心優化參數。本次將學習率設定為 0.0001,優化器選擇 AdamW8bit。訓練排程部分切換為「Steps」模式,總步數設定為 1,000 步,並維持每 200 步存檔一次的頻率,這對初次訓練特定角色來說是個非常穩定的起點。

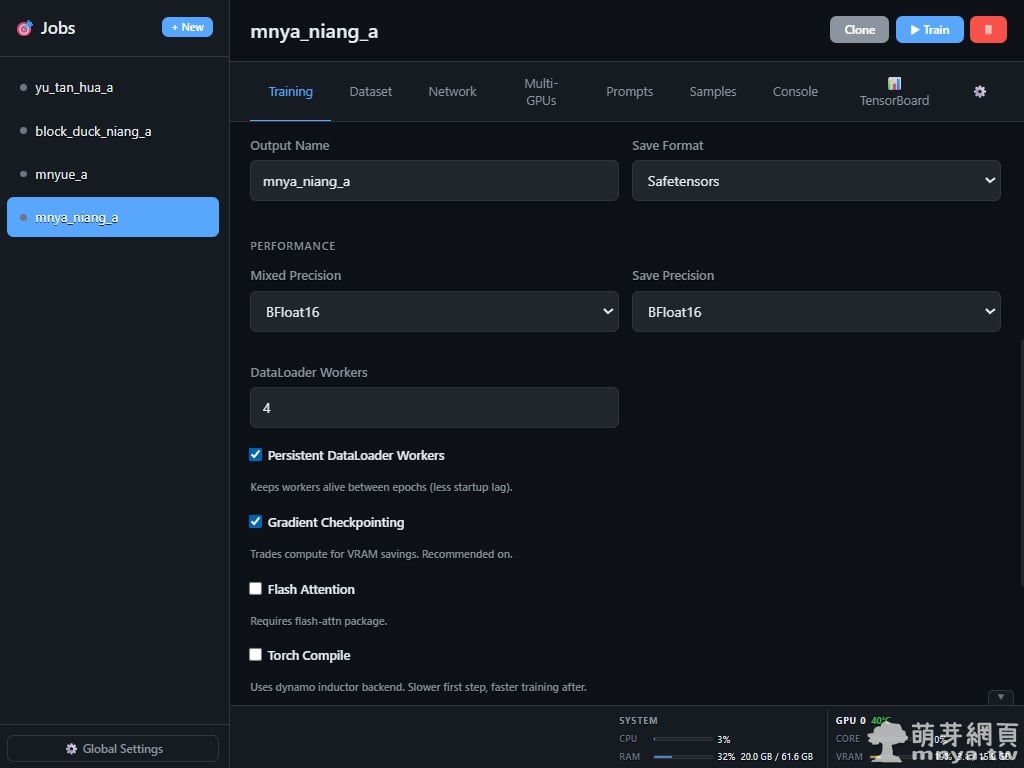

▲ 效能設定是讓消費級顯卡跑動訓練的關鍵。將 Mixed Precision 與 Save Precision 統一改為 BFloat16。務必勾選「Gradient Checkpointing」以節省顯存。此外開啟「Persistent DataLoader Workers」能減少每輪訓練開始時的等待延遲。

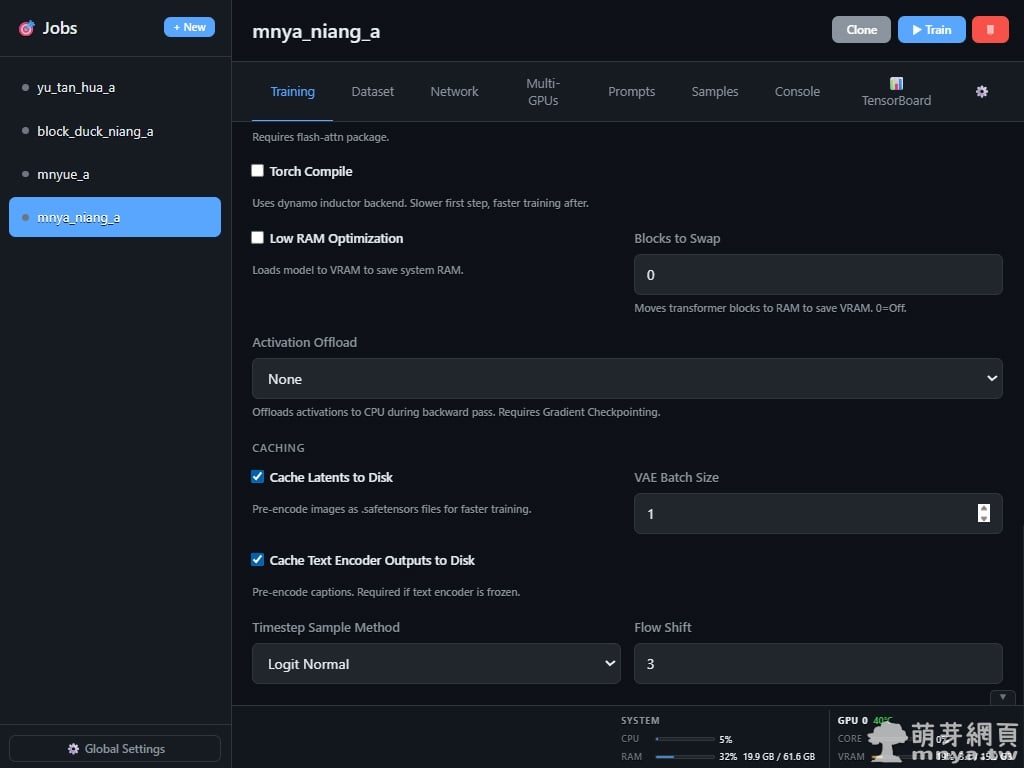

▲ 緩存設定能大幅縮短重複訓練的時間。勾選「Cache Latents to Disk」與「Cache Text Encoder Outputs」能避免反覆運算 VAE 與 Qwen。採樣方法選用「Logit Normal」,並依據 Anima 模型特性將 Flow Shift 設定為 3,確保梯度更新的平滑度。

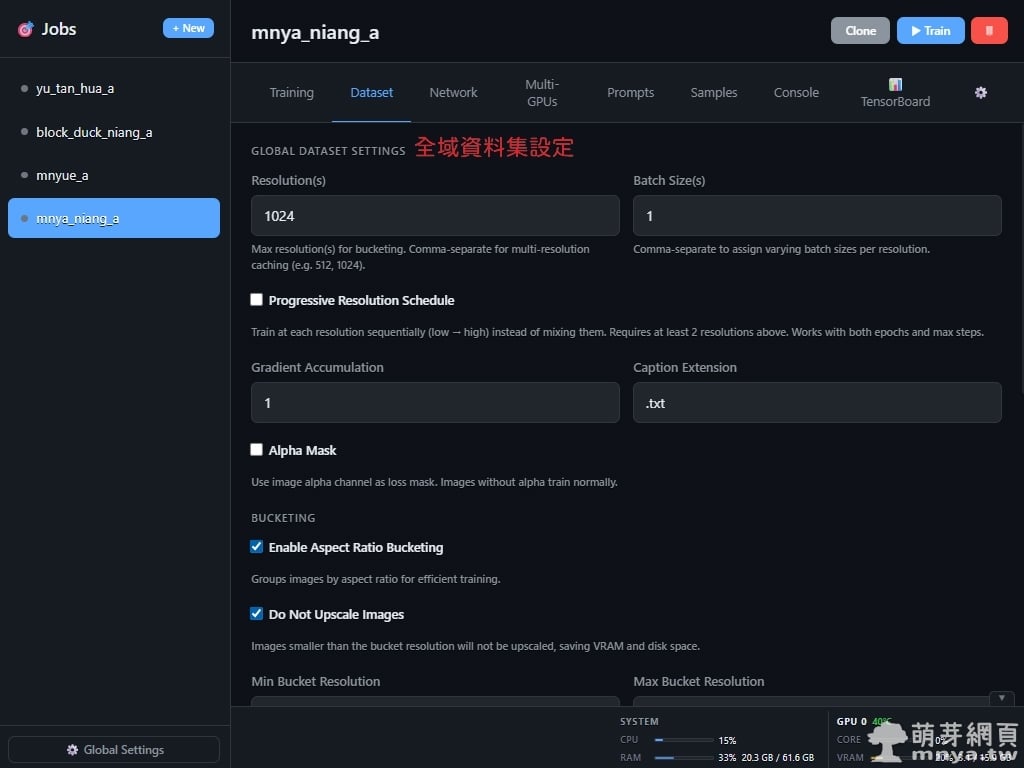

▲ 切換至「Dataset」分頁進行資料集全域設定。Resolution 設為 1024,搭配 Batch Size 為 1。開啟「Enable Aspect Ratio Bucketing」與「Do Not Upscale Images」,這能防止解析度過低的素材被過度拉伸,同時讓模型學會適應多種長寬比構圖。

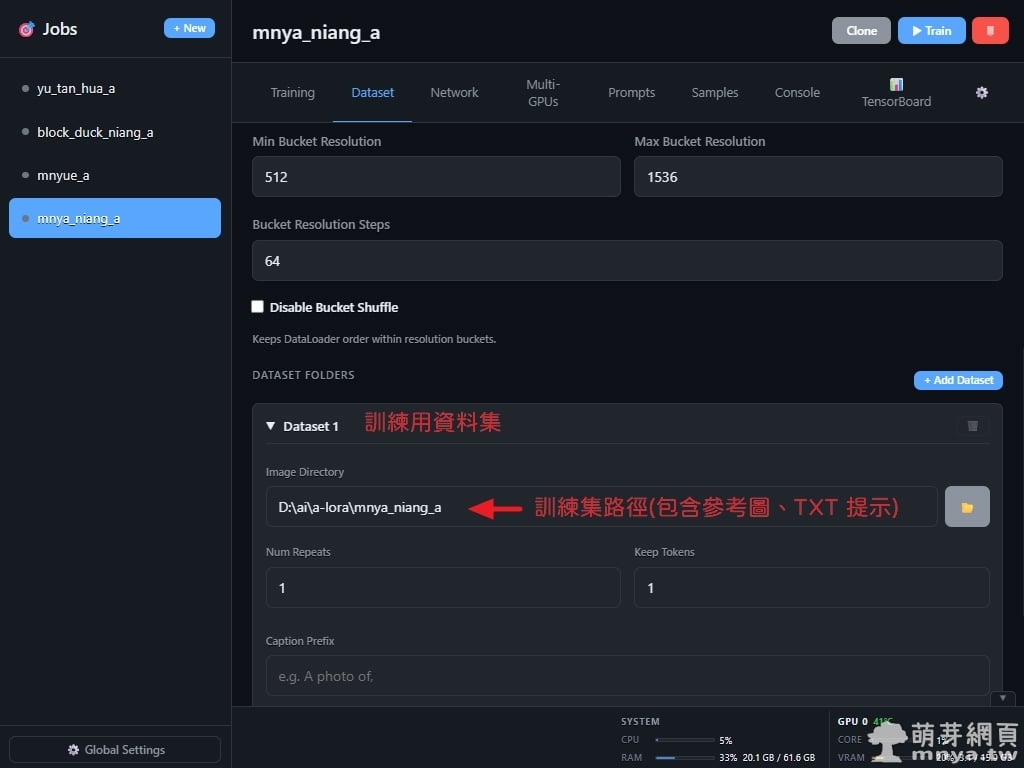

▲ 在資料夾設定中精確填入存放「萌芽娘」參考圖的路徑。本次範例使用的訓練集包含高品質參考圖(建議 10 至 15 張圖)與對應的 TXT 提示詞檔。Num Repeats 設定為 1,配合 Caption Dropout Rate 為 0.05,能讓模型在學習特徵的同時,保持一定的泛化能力。

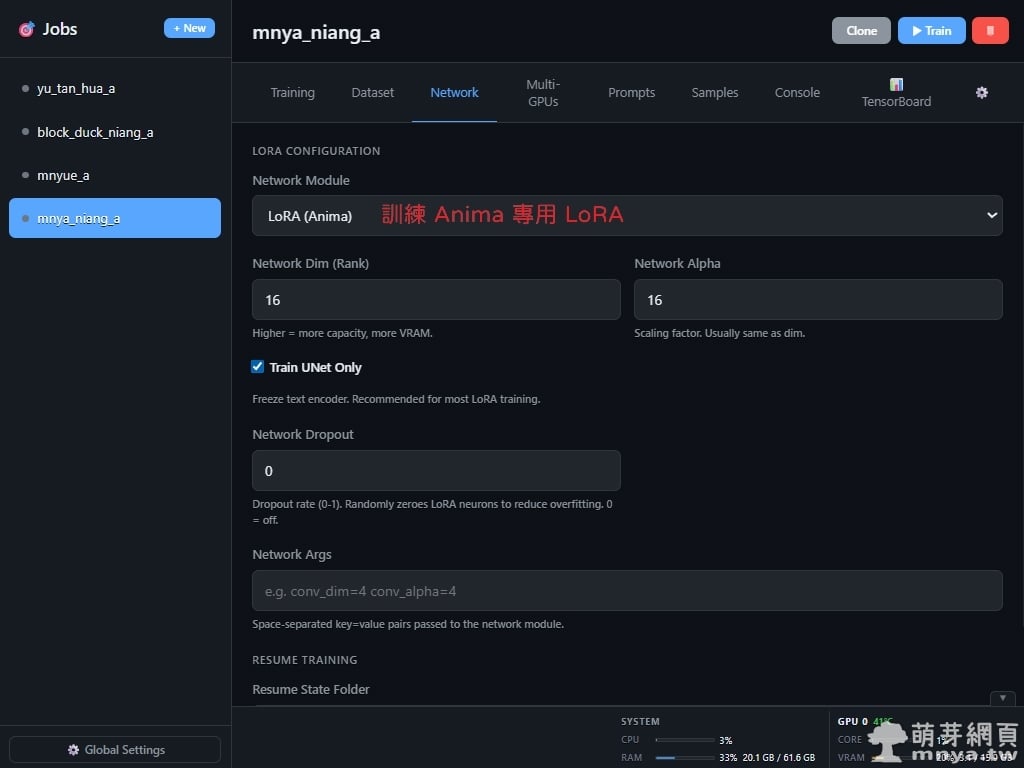

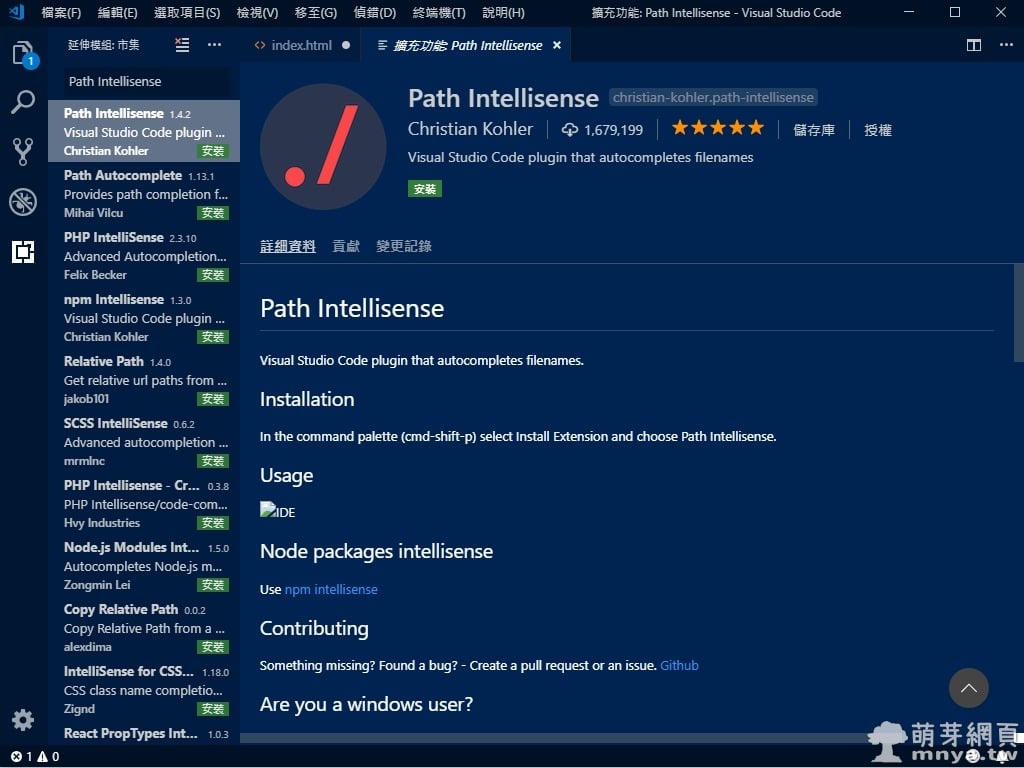

▲ 「Network」分頁中,Module 必須選擇專用的「LoRA (Anima)」。網路維度(Rank/Alpha)均設定為 16。最重要的一步是勾選「Train UNet Only」,因為 Anima 的文字編碼器過於巨大且敏感,僅訓練 UNet 能有效鎖定角色外型而不破壞原有的指令理解力。

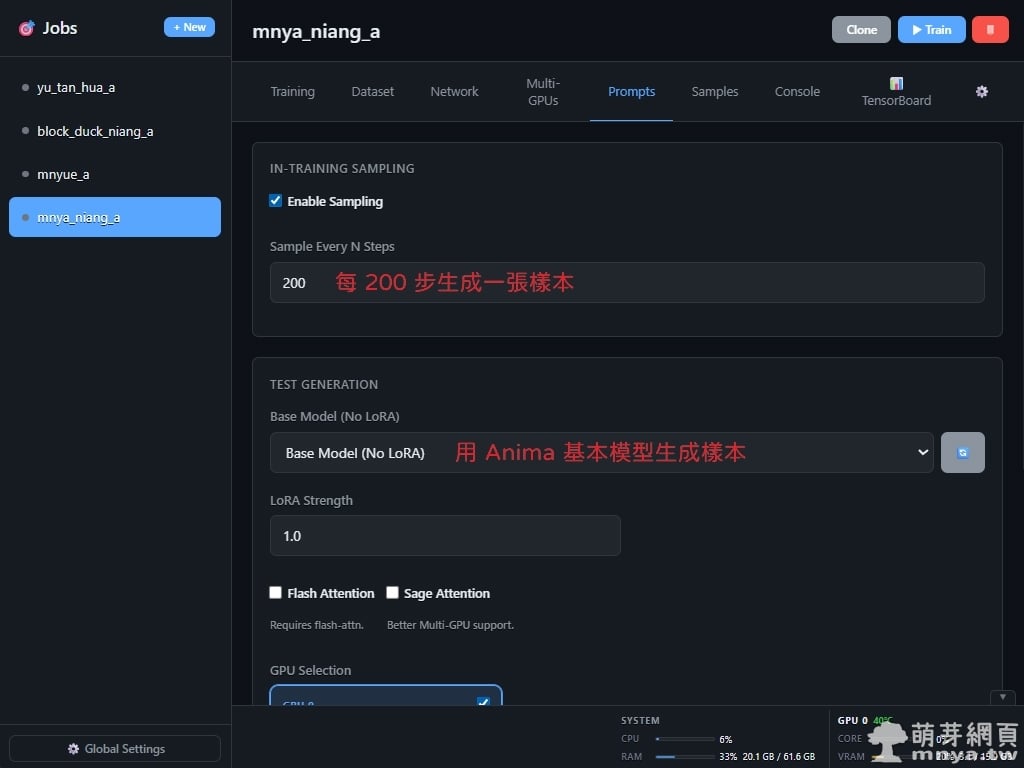

▲ 採樣預覽(Prompts)設定區。開啟「Enable Sampling」並將間隔設為 200 步。這能在訓練過程中隨時監視萌芽娘的藍髮、綠眼與葉片髮飾等細節是否偏移。設定底層生成基準為「Base Model (No LoRA)」,以清楚觀察訓練後的權重變化。

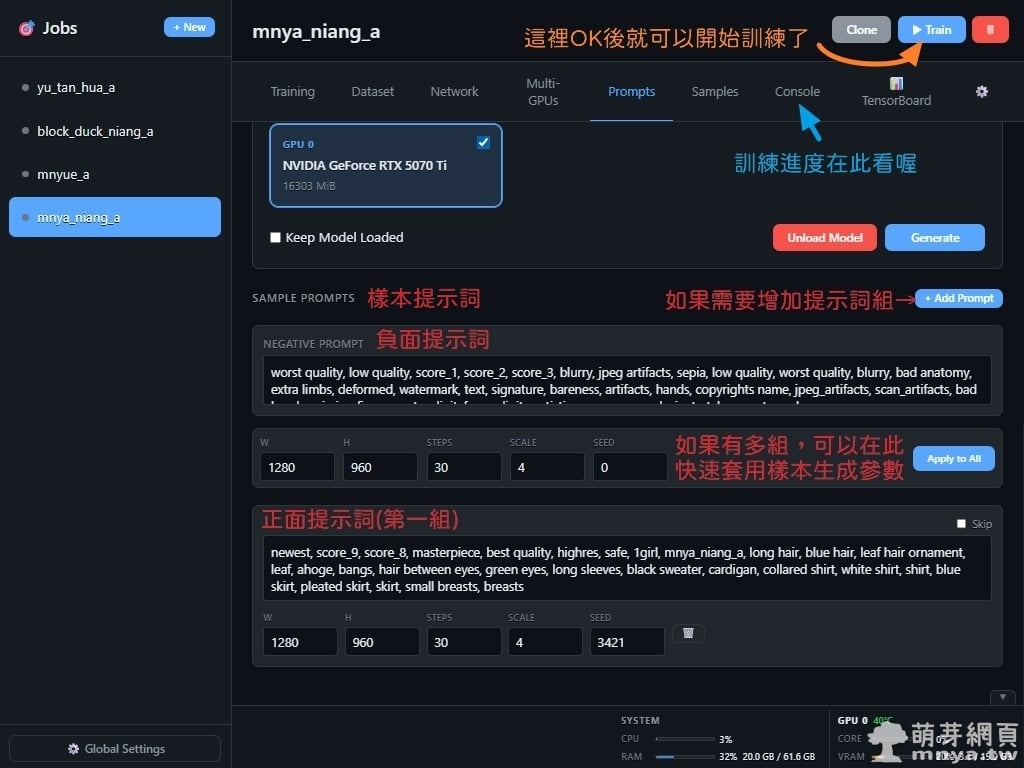

▲ 設定測試樣本的正面提示詞組。除了加入觸發詞「mnya_niang_a」外,也應加入 Anima 建議的品質標籤(如 score_9, masterpiece)。選定 NVIDIA GeForce RTX 5070 Ti(或您的顯卡)後即可點擊右上角的「Train」啟動訓練,過程中可從 Console 即時監控進度。

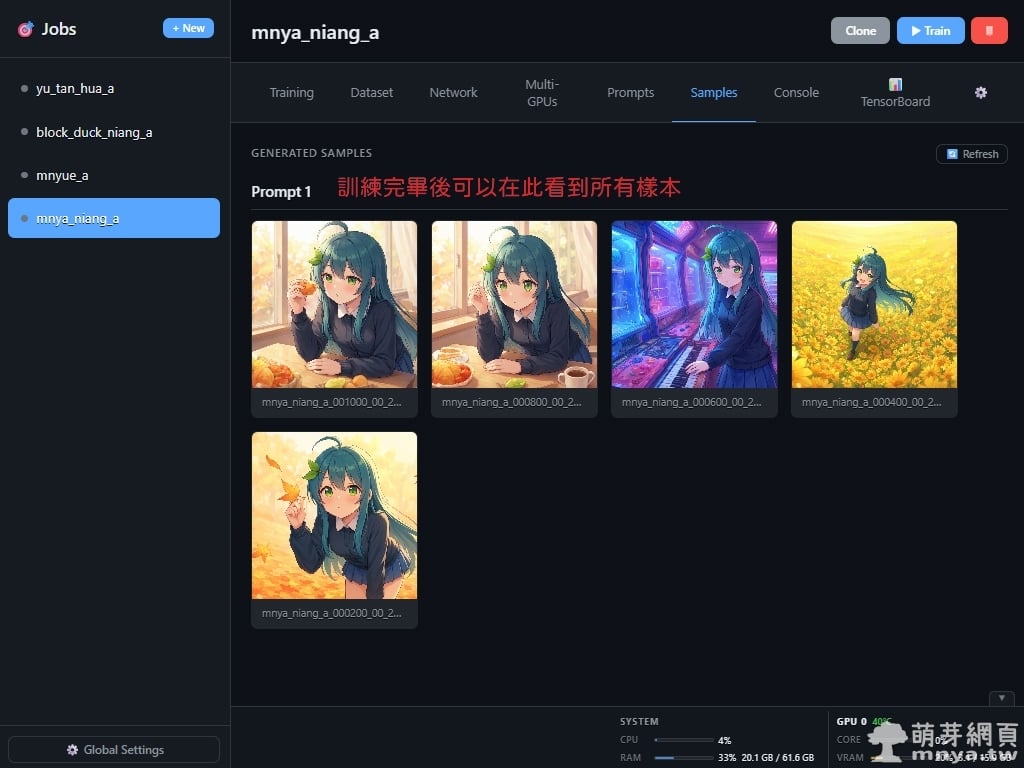

▲ 訓練完成後,切換到「Samples」標籤頁可瀏覽分段生成的樣本。可以看到從 200 步到 1000 步,萌芽娘的形象從雛形逐漸完整,色彩與線條變得更具動漫層次感。最後 1000 步的作品在人物神韻與光影上都達到了非常優異的一致性表現。

▲ 點開單張樣本圖查看詳細資訊,視窗右側會顯示該樣本生成的完整參數。可以看到在 1000 步時,萌芽娘的特徵已經相當穩固。此視窗顯示了採樣器為 Euler、CFG Scale 為 4.0 且解析度為 1280x960。這對訓練後期的微調決策非常有幫助。

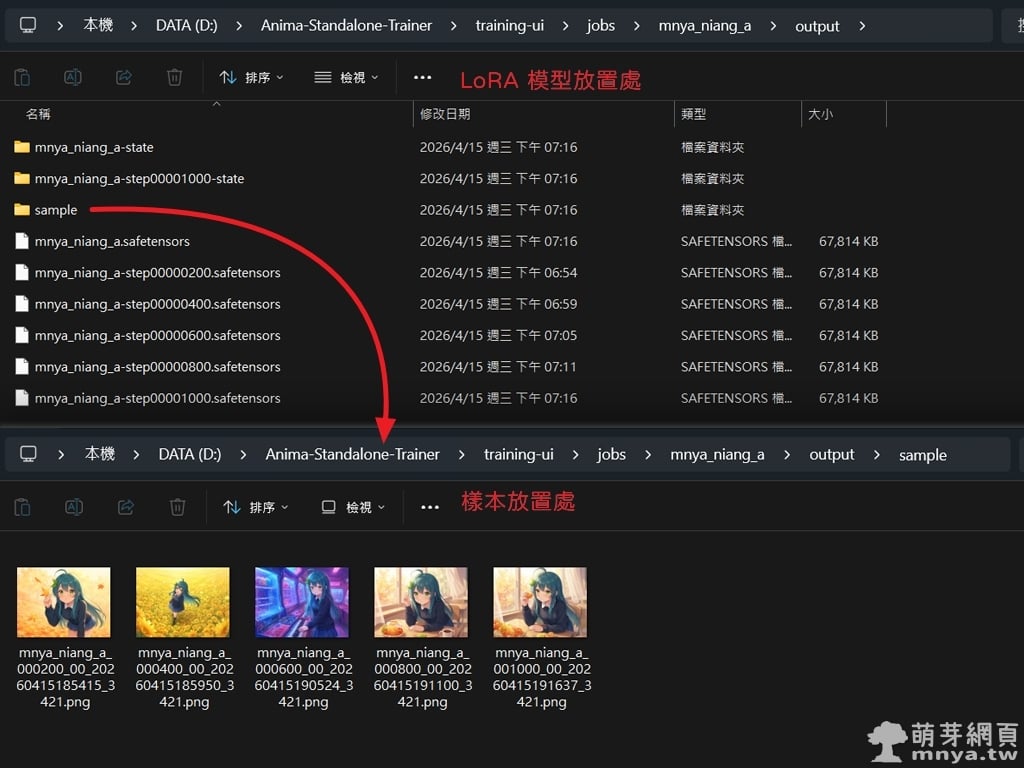

▲ 訓練所得的所有 LoRA 權重會儲存於 Anima-Standalone-Trainer\training-ui\jobs\[任務名稱]\output 目錄下。除了最終的 mnya_niang_a.safetensors 外,還有各階段的備份檔。裡面的 sample 資料夾則存放了訓練中自動生成的樣本圖,方便我們快速對比各階段權重的表現好壞。

示範生成圖

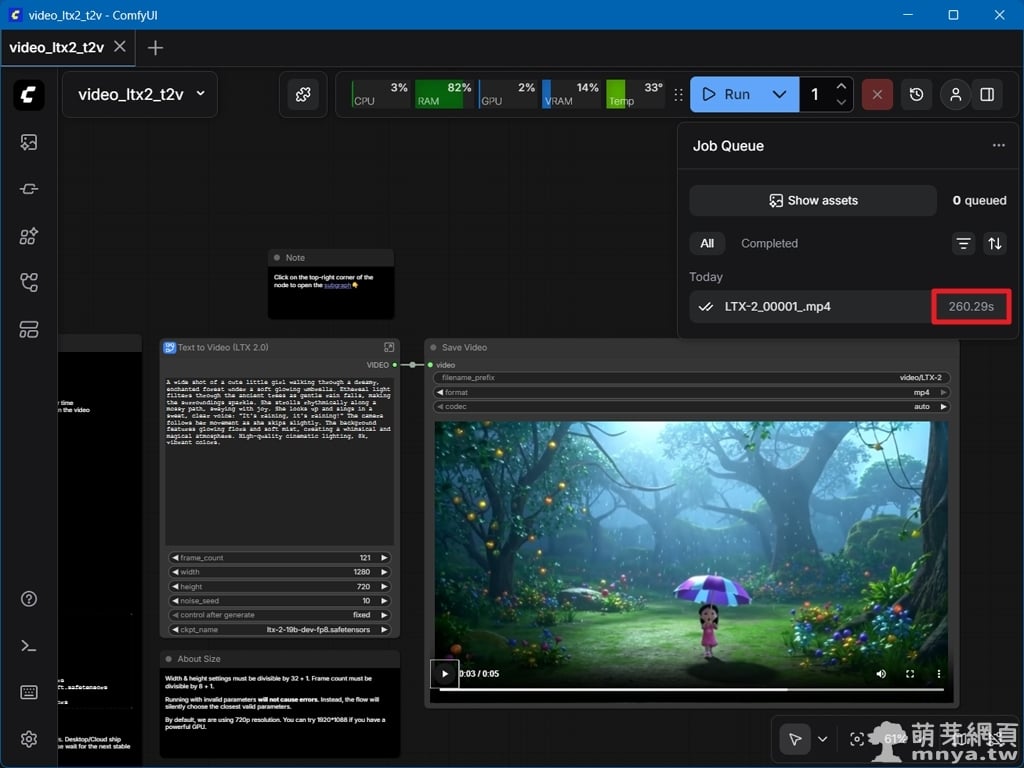

這裡展示將訓練完成的模型導入 ComfyUI 正式環境生成的作品。

▲ 在大樓陽台背景下,萌芽娘的藍色長髮與角色神態捕捉得淋漓盡致。得益於 Anima 強大的動漫底層與本次 LoRA 訓練的精準度,角色與背景之間的合成感極低。

▲ 最後一張示範展示了模型在不同場景下的穩定度。即便是在夜空流星的背景中,萌芽娘的角色特徵依舊保持一致,且模型能完美遵循「閉眼」、「側頭」等指令。透過本次訓練,我們成功在 Anima 模型上建立了一個穩定且高品質的角色相符方案。

《上一篇》Anima Standalone Trainer:在 Windows 快速架設 Anima 2B 獨立 LoRA 訓練環境

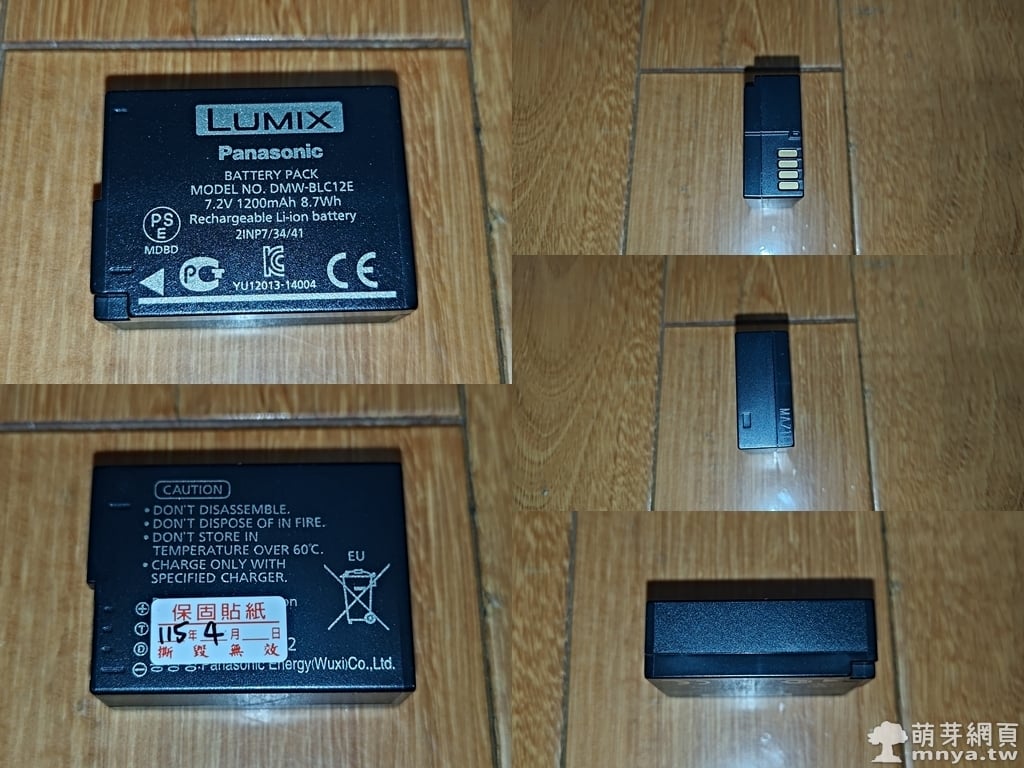

《上一篇》Anima Standalone Trainer:在 Windows 快速架設 Anima 2B 獨立 LoRA 訓練環境  《下一篇》【Panasonic 國際牌】DMW-BLC12E 原廠電池

《下一篇》【Panasonic 國際牌】DMW-BLC12E 原廠電池

留言區 / Comments

萌芽論壇