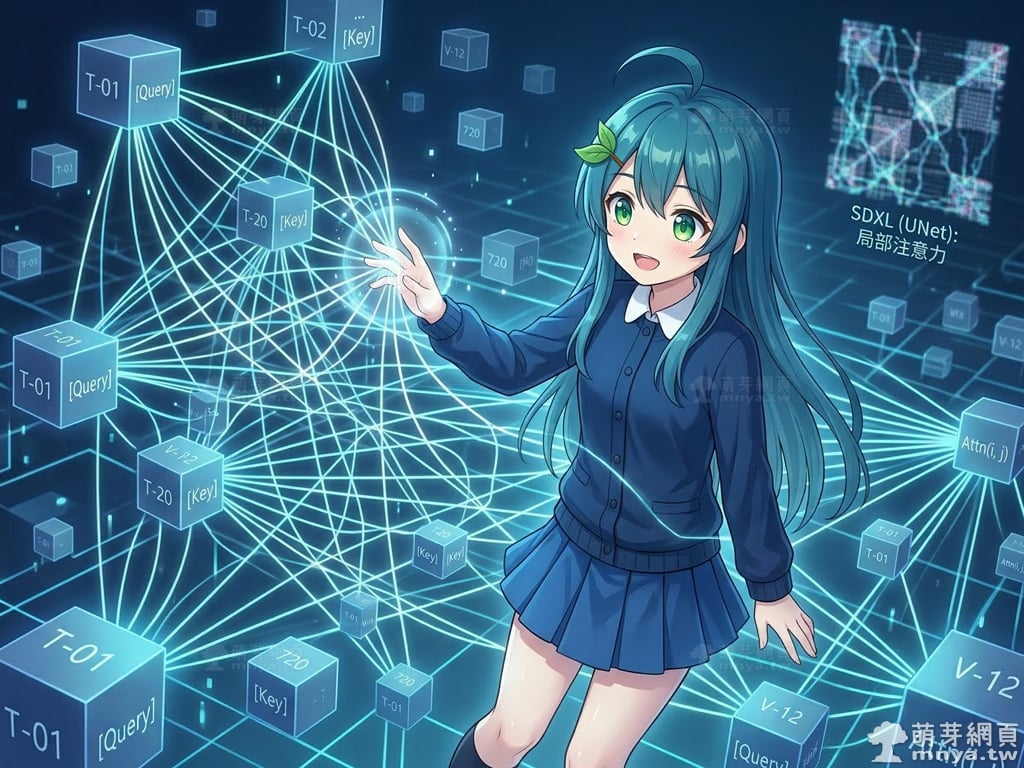

在生成式 AI 的二次元創作領域中,Stable Diffusion XL (SDXL) 長期以來扮演著中流砥柱的角色,但隨著 NVIDIA Cosmos 系列架構的釋出,衍生出的 Anima 模型正揭示了技術底層的典範轉移。兩者最根本的差異在於「神經網路主幹」的進化:SDXL 採用的是傳統的 UNet 卷積神經網路架構,其運作邏輯是透過層層卷積核進行局部特徵的下採樣與還原,這在處理單一物件細節時表現優異,但在處理複雜透視或全局構圖時,往往受限於卷積感受野的局限。而 Anima 則繼承了 Cosmos 的 DiT (Diffusion Transformer) 架構,將圖像在潛在空間中切分為離散的 token(通常為 patch 或 latent token),並透過自注意力機制(Self-Attention)在全局範圍內計算各個 token 之間的全局關聯性。這意味著 Anima 能像大型語言模型(LLM)理解句子邏輯一樣,精確地佈局畫面中的空間結構與語義關聯,顯著提升了二次元場景中多角色互動與複雜物理動態的穩定性。

| 技術維度 | Stable Diffusion XL (SDXL) | Anima (基於 Cosmos) |

|---|---|---|

| 核心主幹 (Backbone) | UNet 卷積神經網路 | DiT (Diffusion Transformer) |

| 文字編碼器 (Text Encoder) | CLIP (OpenCLIP-ViT/G + CLIP-L) | Qwen 3 0.6B Base (LLM) |

| 視覺編解碼器 (VAE) | Standard 8-channel VAE | Qwen-Image VAE (High-fidelity) |

| 語義理解深度 | 基於標籤 (Tag-based) 匹配 | 具備自然語言 (Natural Language) 理解力 |

除了主幹架構的革新,文字編碼器的「大腦」升級是 Anima 另一項關鍵技術特徵。SDXL 依賴 CLIP 模型將文字對應至視覺潛在空間,這種方式對於具體的標籤(如 "1girl, blue hair")反應靈敏,但在處理涉及邏輯敘述的指令時,容易出現語義污染(Prompt Bleeding)或忽略長句後段描述的問題。Anima 則改用了 Qwen 3 0.6B Base 這一具備數億參數的大型語言模型作為編碼器。LLM 的引入讓 Anima 具備了真正的語意解碼能力,它能區分「穿著紅色上衣的少女推著裝滿藍色花朵的小車」中各個形容詞的歸屬對象。此外,Anima 使用的 Qwen-Image VAE 在潛在空間的資訊壓縮效率上進行了優化,這使其生成的線條更為流暢、色塊邊緣更為純淨,有效解決了 SDXL 在生成極細微筆觸時常見的噪點閃爍問題,這對於追求「賽璐珞」或「平面繪畫感」的創作者來說是極大的技術利好。

總結來說,Anima 與 SDXL 的差異在於從「像素機率匹配」轉向「全局語義建模」。隨著計算能力從卷積運算轉向 Transformer 的注意力機制計算,Anima 雖然在顯存頻寬的需求上更具挑戰性,但其帶來的構圖一致性與語義準確度,是傳統 UNet 架構較難達成的。這不僅僅是模型版本的更新,更是生成式圖像技術邁向「世界基礎模型」邏輯的重要實踐。

技術邏輯流對比

[SDXL 流程]

Prompt --> CLIP Embedding --> UNet Noise Prediction (Local) --> Pixel Reconstruction[Anima 流程]

Prompt --> Qwen LLM Hidden States --> DiT Global Attention (Token-based) --> Latent --> Qwen VAE

《上一篇》Anima:全新 2B 參數二次元模型,能否駕馭虛實構圖的圖片?

《上一篇》Anima:全新 2B 參數二次元模型,能否駕馭虛實構圖的圖片?  《下一篇》【日本網卡】DJB 暢日卡PLUS 7天吃到飽不降速

《下一篇》【日本網卡】DJB 暢日卡PLUS 7天吃到飽不降速

留言區 / Comments

萌芽論壇