想在本地用中文提示詞,直接對圖片下指令,完成「換衣服、換背景、合成多張圖片」這類過去要靠多模型、多節點才能做到的圖片編輯工作?這篇文章要介紹的是一條極度精簡、但功能完整的 ComfyUI 圖片編輯工作流,核心只仰賴一個模型:Qwen-Rapid-AIO。

Qwen-Rapid-AIO 的全稱為 Qwen-Image-Edit-Rapid-AIO。它的定位很明確:把加速器(accelerators)、VAE 與 CLIP 直接合併整合,讓你可以用更簡單的方式、用更快的速度,在本機完成 Qwen Image Edit 的圖片編輯(同時也支援文字生圖)。

這條工作流的設計目標很單純:用最少的節點,完成最常見、最實用的圖片編輯流程。你可以直接用自然語言描述「要怎麼改圖」,例如把 A 圖的服裝套到 B 圖的人物身上,再放進 C 圖的場景中,而不需要額外拆 Mask、接 ControlNet、或堆疊多個 LoRA。

Qwen-Rapid-AIO 是什麼?為什麼適合做圖片編輯?

Qwen-Image-Edit-Rapid-AIO 是通義千問(Qwen)圖像編輯模型的整合加速版本,最大特色在於:

- 同時理解文字 + 多張圖片

- 直接用自然語言描述「編輯關係」

- 把 accelerators / VAE / CLIP 合併封裝,降低安裝與管理成本

- 對中文提示詞相對友善,適合日常工作流快速反覆嘗試

在 ComfyUI 的實務使用上,它和傳統 Stable Diffusion 圖像編輯流程有很大差異。過去如果你想完成「人物換衣+換背景」,通常會需要:

- 原圖 + Mask(或手動畫遮罩)

- Inpaint / ControlNet / 多個輔助節點

- 多模型搭配(或額外 LoRA)

- 大量手動調參與反覆試錯

而 Qwen-Rapid-AIO 的做法是:把這些操作「收斂成一句話」交給模型理解。

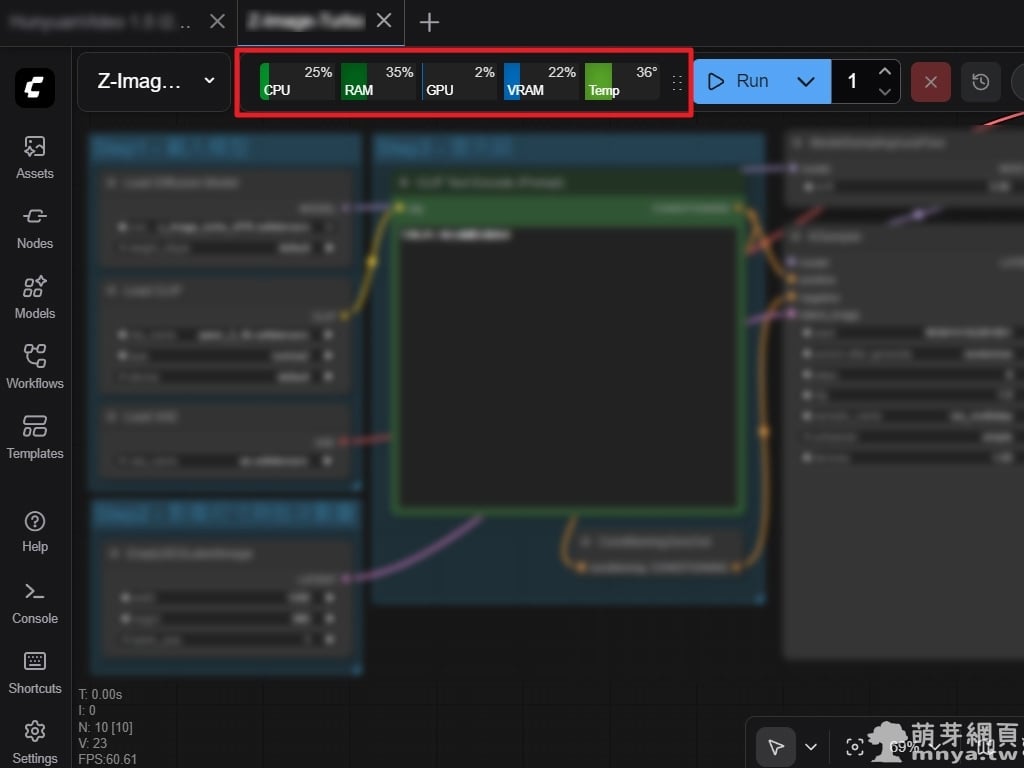

本次實測環境

硬體與測試條件:

- 顯示卡:RTX 5070 Ti 16GB VRAM

- 記憶體:64GB RAM

- 圖片解析度:1280 × 960

- 每批次生成張數:1 張(Batch size 1)

- 取樣步數:4 steps(偏向速度與穩定)

這樣的設定重點不是追求極致畫質,而是驗證:在消費級顯卡上,是否能穩定、快速完成指令式圖片編輯。

環境配置與模型放置

請先完成 ComfyUI 的基本安裝並能正常啟動介面(教學點我)。接著,這套 AIO 的優勢就是:你通常只需要準備一個主要模型檔就能開工。

模型與路徑

- Checkpoint(All-in-One):

Qwen-Rapid-AIO-NSFW-v14.1.safetensors[🔗 下載點]

📁 放置 →ComfyUI/models/checkpoints/

與傳統流程不同的是:accelerators、VAE 與 CLIP 已經被合併整合到同一個 checkpoint(或同一套封裝)裡,你不需要再分別下載與管理多個權重檔,這也是「AIO」命名的核心意義:好放、好載、好跑。我使用 NSFW v14.1,檔案大小約 26.4 GB,若有新版的模型也可以直接使用。v5 及更高版本分別提供 NSFW 和 SFW 版本,請根據您的使用情境選擇合適的模型。

工作流(QwenRapidAIO.json)

將下列內容複製到文字編輯器,儲存為 QwenRapidAIO.json 後即可在 ComfyUI 匯入。

{"id":"760f2540-ff7c-4d78-b027-039b92615744","revision":0,"last_node_id":24,"last_link_id":52,"nodes":[{"id":22,"type":"TextEncodeQwenImageEdit","pos":[-850,250],"size":[400,210],"flags":{},"order":6,"mode":0,"inputs":[{"name":"clip","type":"CLIP","link":45},{"name":"vae","shape":7,"type":"VAE","link":46},{"name":"image","shape":7,"type":"IMAGE","link":null}],"outputs":[{"name":"CONDITIONING","type":"CONDITIONING","links":[47]}],"title":"TextEncodeQwenImageEdit (負面提示詞)","properties":{"Node name for S&R":"TextEncodeQwenImageEdit"},"widgets_values":[""],"color":"#322","bgcolor":"#533"},{"id":7,"type":"KSampler","pos":[-431.9048296409299,-41.249806692962636],"size":[270,262],"flags":{},"order":7,"mode":0,"inputs":[{"name":"model","type":"MODEL","link":35},{"name":"positive","type":"CONDITIONING","link":41},{"name":"negative","type":"CONDITIONING","link":47},{"name":"latent_image","type":"LATENT","link":51}],"outputs":[{"name":"LATENT","type":"LATENT","links":[48]}],"properties":{"Node name for S&R":"KSampler"},"widgets_values":[729324562106631,"randomize",4,1.5,"er_sde","beta",1]},{"id":1,"type":"LoadImage","pos":[-1491.6487378723134,-226.93944223403932],"size":[300,320],"flags":{},"order":0,"mode":0,"inputs":[],"outputs":[{"name":"IMAGE","type":"IMAGE","links":[31]},{"name":"MASK","type":"MASK","links":null}],"title":"圖1","properties":{"Node name for S&R":"LoadImage"},"widgets_values":["ComfyUI_00244_.png","image"],"color":"#2a363b","bgcolor":"#3f5159"},{"id":3,"type":"LoadImage","pos":[-1176.5744446807864,-25.904737872313994],"size":[300,320],"flags":{},"order":1,"mode":0,"inputs":[],"outputs":[{"name":"IMAGE","type":"IMAGE","links":[33]},{"name":"MASK","type":"MASK","links":null}],"title":"圖3","properties":{"Node name for S&R":"LoadImage"},"widgets_values":["ComfyUI_00246_.png","image"],"color":"#2a363b","bgcolor":"#3f5159"},{"id":2,"type":"LoadImage","pos":[-1490.4774757446298,134.7733689361574],"size":[300,320],"flags":{},"order":2,"mode":0,"inputs":[],"outputs":[{"name":"IMAGE","type":"IMAGE","links":[32]},{"name":"MASK","type":"MASK","links":null}],"title":"圖2","properties":{"Node name for S&R":"LoadImage"},"widgets_values":["低胸黑色洋裝.png","image"],"color":"#2a363b","bgcolor":"#3f5159"},{"id":23,"type":"EmptyLatentImage","pos":[-1175.7839881441319,335.91982294493937],"size":[300,110],"flags":{},"order":3,"mode":0,"inputs":[],"outputs":[{"name":"LATENT","type":"LATENT","links":[51]}],"properties":{"Node name for S&R":"EmptyLatentImage"},"widgets_values":[1280,960,1]},{"id":19,"type":"TextEncodeQwenImageEditPlus","pos":[-849.938413337491,-49.65787270487071],"size":[400,260.555185829773],"flags":{},"order":5,"mode":0,"inputs":[{"name":"clip","type":"CLIP","link":36},{"name":"vae","shape":7,"type":"VAE","link":38},{"name":"image1","shape":7,"type":"IMAGE","link":31},{"name":"image2","shape":7,"type":"IMAGE","link":32},{"name":"image3","shape":7,"type":"IMAGE","link":33}],"outputs":[{"name":"CONDITIONING","type":"CONDITIONING","links":[41]}],"title":"TextEncodeQwenImageEditPlus (正面提示詞)","properties":{"Node name for S&R":"TextEncodeQwenImageEditPlus"},"widgets_values":["圖2服裝穿在圖1少女身上,並讓其站在圖3場景中"],"color":"#232","bgcolor":"#353"},{"id":4,"type":"CheckpointLoaderSimple","pos":[-850,-190],"size":[400,100],"flags":{},"order":4,"mode":0,"inputs":[],"outputs":[{"name":"MODEL","type":"MODEL","links":[35]},{"name":"CLIP","type":"CLIP","links":[36,45]},{"name":"VAE","type":"VAE","links":[38,46,49]}],"properties":{"Node name for S&R":"CheckpointLoaderSimple"},"widgets_values":["Qwen-Rapid-AIO-NSFW-v14.1.safetensors"],"color":"#432","bgcolor":"#653"},{"id":24,"type":"SaveImage","pos":[-145.63168896200472,-99.25551434754097],"size":[314.5277031053049,443.48382549758196],"flags":{},"order":9,"mode":0,"inputs":[{"name":"images","type":"IMAGE","link":52}],"outputs":[],"properties":{"Node name for S&R":"SaveImage","cnr_id":"comfy-core","ver":"0.3.64","enableTabs":false,"tabWidth":65,"tabXOffset":10,"hasSecondTab":false,"secondTabText":"Send Back","secondTabOffset":80,"secondTabWidth":65},"widgets_values":["QwenRapidAIO/ComfyUI"]},{"id":8,"type":"VAEDecode","pos":[-429.3301494637449,262.95071704522655],"size":[271.18332425537096,46],"flags":{},"order":8,"mode":0,"inputs":[{"name":"samples","type":"LATENT","link":48},{"name":"vae","type":"VAE","link":49}],"outputs":[{"name":"IMAGE","type":"IMAGE","links":[52]}],"properties":{"Node name for S&R":"VAEDecode"},"widgets_values":[]}],"links":[[31,1,0,19,2,"IMAGE"],[32,2,0,19,3,"IMAGE"],[33,3,0,19,4,"IMAGE"],[35,4,0,7,0,"MODEL"],[36,4,1,19,0,"CLIP"],[38,4,2,19,1,"VAE"],[41,19,0,7,1,"CONDITIONING"],[45,4,1,22,0,"CLIP"],[46,4,2,22,1,"VAE"],[47,22,0,7,2,"CONDITIONING"],[48,7,0,8,0,"LATENT"],[49,4,2,8,1,"VAE"],[51,23,0,7,3,"LATENT"],[52,8,0,24,0,"IMAGE"]],"groups":[],"config":{},"extra":{"ds":{"scale":0.8264462809917354,"offset":[1615.8674613008734,449.94655177735046]},"workflowRendererVersion":"LG","frontendVersion":"1.34.9","VHS_latentpreview":false,"VHS_latentpreviewrate":0,"VHS_MetadataImage":true,"VHS_KeepIntermediate":true},"version":0.4}匯入工作流後若提示遺失節點,建議使用 ComfyUI-Manager 搜尋安裝相關套件。安裝完成後務必重啟 ComfyUI,節點才會出現在清單中。

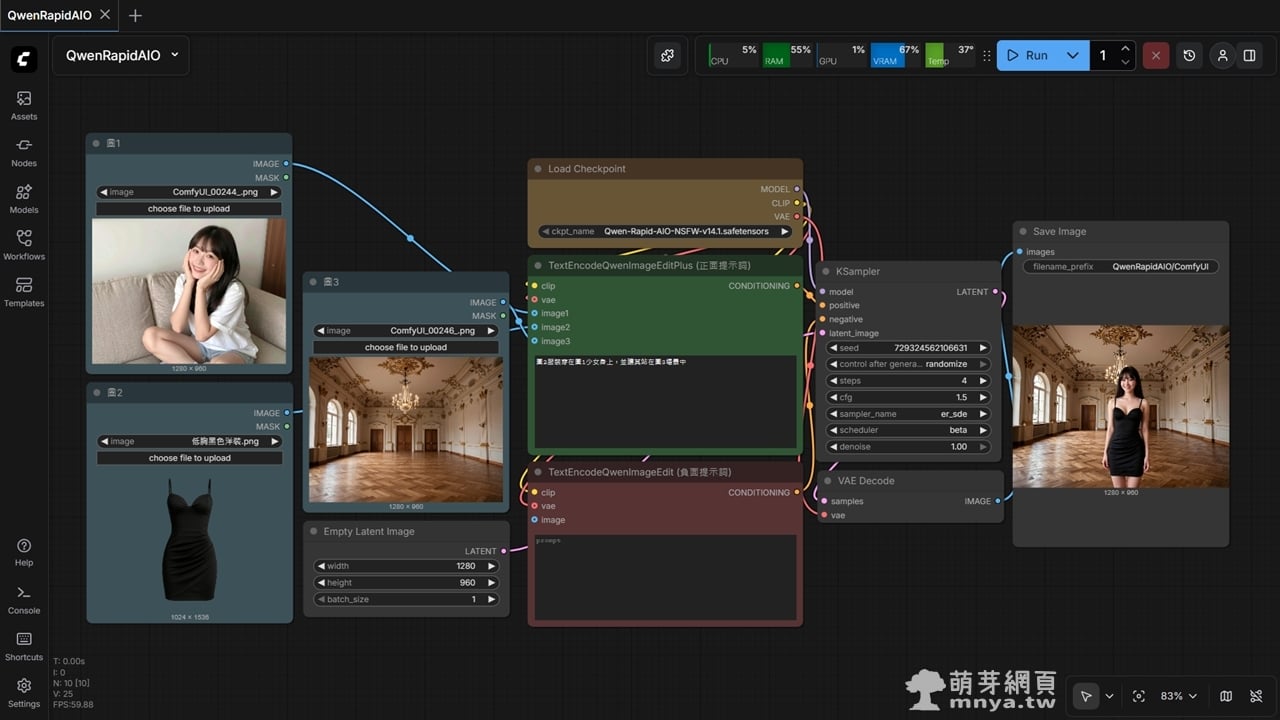

▲ ComfyUI 的工作流截圖。

整體流程概念上可以拆成四段:

- Step 1 – 載入模型(AIO Checkpoint)

- Step 2 – 載入圖片素材(可多張)與建立輸出尺寸

- Step 3 – 用文字描述「怎麼改圖」(正向 / 負向)

- Step 4 – 取樣、解碼與輸出

雖然節點數量不多,但背後模型一次處理了「圖像理解、關係推理、畫面生成」三件事,這就是它在工作流層面能做到極簡的原因。

Step 1:載入模型

在工作流最前段使用 CheckpointLoaderSimple 載入 Qwen-Rapid-AIO。這個節點會一次性輸出:

- MODEL

- CLIP

- VAE

後續所有節點都沿用這組輸出,不需要再額外接文字編碼器或額外 VAE,整體流程更直觀。

Step 2:載入圖片與建立畫布

工作流中使用多個 LoadImage 節點分別載入不同用途的圖片素材(例如人物、服裝、背景)。同時用 EmptyLatentImage 建立 1280×960 的 latent 畫布,作為最終輸出尺寸基準。

這樣的設計好處是:你可以把「素材」與「結果尺寸」分開思考,排查問題時也更容易定位。

Step 3:中文提示詞(Prompt)

這是整條工作流的核心:把「我要怎麼改圖」直接用自然語言說清楚。

- TextEncodeQwenImageEditPlus(正面提示詞):

同時接收文字提示詞與多張輸入圖片,負責產生正向 Conditioning。你可以輸入類似:

把圖2服裝穿在圖1少女身上,並讓其站在圖3場景中 - TextEncodeQwenImageEdit(負面提示詞):

用於產生負向 Conditioning。本工作流預設留白,降低使用門檻;需要更強限制時再逐步補上即可。

如果你過去習慣用大量英文 tag 堆疊來控制結果,這套流程的思路會很不一樣:更像是在「下指令」而不是「餵關鍵字」。

Step 4:取樣器與影像輸出

工作流後半段負責取樣、解碼與儲存圖片,主要節點包括:

- KSampler:核心取樣節點。本工作流採用偏速度與穩定的設定:

- 取樣步數:4 steps

- CFG:1.5

- Sampler:

er_sde - Scheduler:

beta

- VAEDecode:將取樣完成的 latent 轉回實際圖片

- SaveImage:輸出圖片檔案;工作流預設資料夾為

QwenRapidAIO/ComfyUI

示範與生成成果

以下示範展示的是典型的「換裝+換背景」應用場景,全程不需要手動遮罩或額外輔助模型。所有素材皆為 AI 生成。

📝 正面提示詞:圖2服裝穿在圖1少女身上,並讓其站在圖3場景中

▲ 此為輸入的服裝素材圖(圖2)及指定人物照(圖1)。只要單獨提供一件黑色貼身洋裝,模型會將其視為「可被套用的服裝來源」,並在後續生成時參考其剪裁、材質與整體輪廓,而不是單純貼圖或覆蓋。

▲ 此為背景場景圖片(圖3),內容是一個挑高、對稱構圖的歐式室內空間。工作流中僅將它作為「場景參考」,模型會依照人物比例與光線邏輯,自動判斷合適的站位與視角。

▲ 最終生成結果。模型成功將指定服裝「穿」在人物身上,並自然地融合進指定的室內場景中,人物比例、服裝貼合度與整體光影方向保持一致,沒有明顯拼貼或遮罩痕跡,呈現出完整的一張成品圖。以我的硬體設備及設定參數,一張成品只要跑 30 秒左右。

結語

Qwen-Rapid-AIO(Qwen-Image-Edit-Rapid-AIO)把圖片編輯這件事,從「堆節點、手動切圖、到處找模型」拉回到「一句話說清楚我要改什麼」。透過把 accelerators、VAE、CLIP 合併整合,它在 ComfyUI 的實務體驗上更接近一個可直接上手的本機圖片編輯引擎:好載入、好管理,也更容易複用成日常工作流。

如果你追求的是「可控、穩定、可重複使用」的圖片編輯流程,而不是一次性的炫技輸出,那麼這條 ComfyUI × Qwen-Rapid-AIO 的極簡工作流,會是一個很值得收進常用範本的選擇。

《上一篇》WanGP x Wan 2.2 Animate:參考動作製作指定角色 AI 跳舞影片

《上一篇》WanGP x Wan 2.2 Animate:參考動作製作指定角色 AI 跳舞影片  《下一篇》Z-Image Turbo vs Beyond Reality:原版與人像微調模型的比較

《下一篇》Z-Image Turbo vs Beyond Reality:原版與人像微調模型的比較

留言區 / Comments

萌芽論壇